Nvidia GTC (eller GPU Technology Conference) er blevet en af verdens førende AI-konferencer, der vokser hvert år siden lanceringen i 2009 sammen med virksomhedens indflydelse og indtægter. Men dette år markerede et skift i vægten. Tidligere fokuserede virksomheden på, hvordan den ekspanderede til nye markeder; i år viste det, hvordan det ville ekspandere inden for disse markeder, især som en nøglespiller på tværs af AI-landskabet. Som et tydeligt tegn på Nvidias ambitioner og dets nuværende succes opgraderede det sin fremskrivning for 500 milliarder dollars i AI-indtægter i 2026 til svimlende 1 billioner dollars i 2027.

Særligt administrerende direktør Jensen Huang adresserede voksende behov inden for AI-inferencing såvel som den hurtige vækst af agentiske arbejdsbelastninger, og hvordan denne vækst kan påvirke al AI-computing.

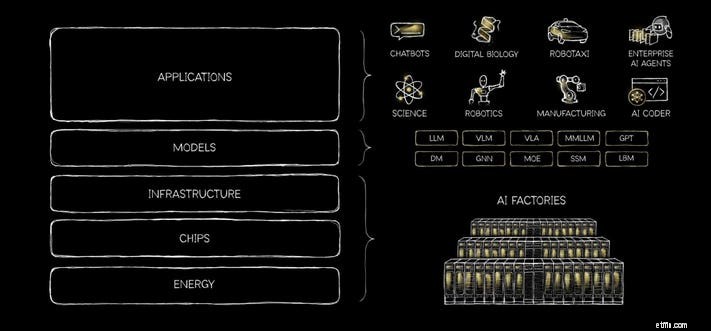

Siden december 2025 har Huang promoveret ideen om en "fem-lagskage" af AI. Dette koncept ser ud til at indkapsle virksomhedens overordnede strategi for AI, da det forsøger at kommunikere teknologiens iboende vertikale karakter, som er langt mere kompleks end en simpel app eller model. AI er portrætteret som kritisk infrastruktur med flere lag lige fra underliggende energikrav hele vejen op til individuelle applikationer. Dette forsøger også at forenkle kompleksiteten af en komplet AI-stak for den gennemsnitlige person.

Nvidias femlagskage af AI

Foto udlånt af Nvidia

I bunden af denne stak er energi, som trækker mere opmærksomhed som den begrænsende faktor for, hvor meget computere, der kan bygges på et givet sted. Til gengæld bestemmer de chips, der bruger denne energi, mængden af computere, der er tilgængelige for at løse AI-problemer. Dernæst kommer infrastrukturen, der understøtter disse chips med jord, bygninger, strømforsyning, computerudstyr, køling og netværk. Infrastrukturen muliggør AI-modeller, som varierer afhængigt af applikationen og use casen. På øverste niveau udnytter applikationerne selv modeloutput til at levere resultater for forbrugere, forretningsbrugere, statslige enheder og så videre - på grundlag af AI's økonomiske værdi.

Huang sagde, at hele computerstakken skulle genopfindes for at understøtte "den største infrastrukturudbygning i menneskehedens historie." Nvidia bruger denne meddelelse til at positionere sig ikke kun som en chipmaker, men som en grundlæggende muliggører for al databehandling, fordi al databehandling nu bevæger sig mod AI. Den administrerende direktør taler om Nvidias tilgang, der kombinerer "vertikal integration og horisontal åbenhed", hvilket betyder, at dens modeller er åbne for alle, men dens tilgang til databehandling er vertikalt integreret i hvert lag.

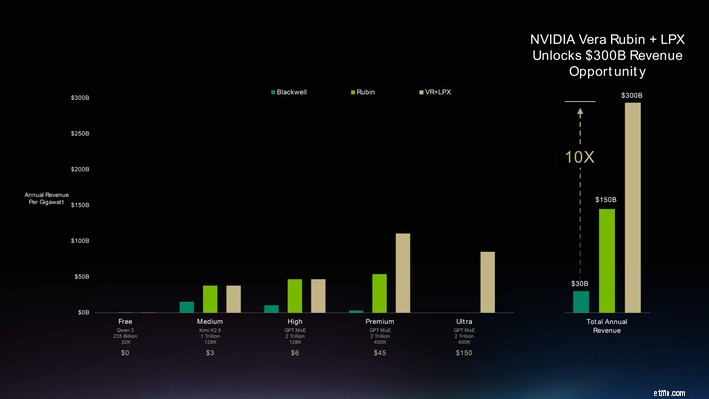

Vera Rubin er den kommende avancerede computerplatform til Nvidia, der kombinerer sine Vera CPU'er og Rubin GPU'er; det er planlagt til at begynde levering om et par måneder fra nu. Vera Rubin Pod er Nvidias rack-skala-tilbud, der lover at levere endnu en betydelig stigning i AI-beregningstætheden i datacentre. Det inkorporerer syv typer af Nvidias chips på tværs af fem forskellige rack-systemer for at skabe en højtydende konfiguration, som virksomheden siger vil muliggøre tokengenerering - og indtjening - med op til 10 gange hastigheden af sidste generations Blackwell-platform. Nvidia hævder, at dette kunne muliggøre så meget som en $300 milliarder årlig slutningsmulighed.

Diagram, der nedbryder Nvidias arkitektoniske slutningsmuligheder

Foto udlånt af Nvidia

En af de største muliggørende faktorer ved Vera Rubin Pod er brugen af Groqs LPX-platform, der udnytter Groq 3 LM30-chippen. Groqs sprogbehandlingsenhed er i sagens natur forskellig fra Nvidias GPU'er, med en betydelig mængde SRAM (static random access memory) i modsætning til DRAM (dynamic random access memory). Fordi den øger hukommelsesbåndbredden med forbløffende 55x sammenlignet med en Rubin GPU, er Groq LPU i sagens natur god til at håndtere ekstremt hukommelsesintensive opgaver. Dette er med til at forklare, hvorfor Nvidia købte Groqs IP og dets vigtigste talent for 20 milliarder dollars i december 2025.

Groq-eksemplet viser, hvordan Nvidia bevæger sig væk fra at forsøge at gøre sine GPU'er til løsningen på ethvert problem. Mens Nvidias økosystem længe har udvidet sig ud over GPU'er, har denne udvidelse næsten altid været i tjeneste for GPU'en, uanset om det er CPU'er, netværkschips eller software. Med introduktionen af Groq 3 LPU'erne er Nvidias computerarkitektur virkelig vokset fra en GPU-kun-tilgang.

Vi ser også, at Nvidia begynder at tilbyde produkter som f.eks. sine egne arm-baserede CPU'er i en rackløsning, der kun er CPU. Virksomheden positionerer den nye 88-core Vera CPU som konkurrencedygtig med Intel og AMD til datacentre. Disse CPU'er kan konfigureres med op til 256 chips pr. rack, og Nvidia har allerede kunder, inklusive Meta, der ønsker at implementere dem. Ud over CPU'er talte Nvidia også om sin Bluefield 4 STX-løsning til lagringsorienterede applikationer; ifølge virksomheden forbedrer dette produkt ydeevnen for at forhindre opbevaring i at være en flaskehals for AI-output.

Nvidia DSX er virksomhedens seneste Vera Rubin-baserede platform for dets AI Factory-tilbud, som inkluderer et referencedesign til AI-fabrikker og udnytter Nvidias Omniverse Digital Twin. (For baggrund om Omniverse, se min nedskrivning af GTC 2025 og min kollega Bill Curtis' detaljerede blik på Nvidias træk inden for fysisk AI fra februar 2025.) Virksomheden kalder dette en nøglefærdig løsning, der udnytter alle de muligheder, Nvidia og dets partnere har skabt til at hjælpe med at planlægge, bygge og vedligeholde AI-fabrikker. Denne platform er designet til implementeringer med hyperskalere og de største virksomheder, der ønsker at implementere deres egen AI i industriel skala uden at skulle sammensætte infrastruktur.

Der har også været meget buzz på det seneste omkring AI-databehandling i rummet, hvor mange startups er blevet lanceret for at løse problemerne med implementering. Forud for annonceringen af Space 1-modulet baseret på Vera Rubin, implementerede Nvidia for det meste indlejrede Jetson Orin-chips og H100 GPU'er til rumapplikationer. Nvidia siger, at det nye rumfokuserede modul er designet til disse ekstreme applikationer og leverer så meget som 25x AI-ydeevnen i rummet som H100. Den har også lockstep-behandling og fejlkorrektionskoder for at sikre, at drift i rummet ikke påvirker output. Når det er sagt, tror jeg, at Space 1 vil adressere en temmelig nicheapplikation og ikke bør ses som en validering af behovet for datacentre i rummet.

Agentisk AI er hurtigt blevet et vigtigt fokusområde, da agenter som Claude Code hjælper brugere med at løse praktiske opgaver. Fra den tekniske side omformer agenter den måde, it-infrastruktur er bygget på, og hvordan chipsene inde i den infrastruktur er designet. En af de mest interessante seneste udviklinger er introduktionen af OpenClaw, en open source-agent, der kører lokalt ved hjælp af Nvidias nye open-source NemoClaw-stak til sikrere udrulninger af opgaveorienterede agenter.

NemoClaw-agentværktøjssættet er designet til at bygge, træne og implementere autonome, sikre AI-agenter, som skulle gøre det nemmere for enhver at oprette deres egne agenter. I udviklingen af den nye stack arbejdede Nvidia tæt sammen med skaberen af OpenClaw og sikkerhedsforskere for at hjælpe med at forhindre uønskede agenthandlinger eller potentielt farlige udfald.

Nvidia overraskede mange, inklusive mig, med annonceringen af DLSS 5.0, som er virksomhedens valgfri AI-assisterede funktion til at forbedre billedkvaliteten og levere hurtigere gengivelse. Det fungerer ved at gengive med en lavere opløsning og derefter bruge AI til at opskalere billedet til den oprindelige opløsning. De fleste brugere ser ud til at være tilfredse med tidligere implementeringer af DLSS. Nu introducerer DLSS 5.0 neurale gengivelsesteknikker for yderligere at forbedre belysningen i scener, der ellers kunne se flade ud. Det giver også spiludviklere mere kontrol over brugeroplevelsen, og de kan tune DLSS 5.0 for at ændre, hvordan det påvirker det visuelle i deres spil.

Mange mennesker har reageret negativt på tidlige fotos og videoer lavet med DLSS 5.0. Jeg synes, det er en markant overreaktion. Der er mange spillere, der hader de fleste AI-forbedrede ting, og reaktionen på DLSS 5.0 kan være en kulmination på den frustration. Efter at have set demoerne personligt, kan jeg sige, at næsten alle forbedringerne ser ud til at være positive og forbedre realismen - og dette kommer fra en seriøs fotograf, der kan være meget kræsen med redigeringsværktøjer. Ud over det er DLSS 5.0 stadig langt fra levering, så det er uklart, præcis hvordan det endelige produkt vil se ud, eller hvilke GPU'er der vil kunne køre det. Den nuværende instansiering kører på to Nvidia RTX 5090-grafikkort, men ifølge Nvidia vil softwaren være optimeret til at køre på en enkelt GPU til efteråret.

I sine bemærkninger på GTC talte Huang om den voksende AI-indtægtsmulighed for industrien og tilføjede, at "Efterspørgslen efter Nvidia GPU'er er ude af hitlisterne." Han hævdede, at slutningsvækst driver betydeligt mere omsætning siden den særlige udgave af GTC, der blev afholdt i Washington, D.C. i slutningen af 2025 (som jeg skrev om her).

Selvom det kun var et par måneder siden, opgraderer virksomheden nu sin forventede omsætningsmulighed på 500 milliarder dollars gennem 2026 til 1 billion dollars gennem 2027. Det betyder, at Nvidia ikke kun forventer, at dette år slutter stærkt, men også forventer, at 2027 bliver endnu stærkere - hundredvis af milliarder af dollars stærkere. Fra mit perspektiv som analytiker gav det mening at tro, at overgangen fra AI-træning til udbredt AI-inferens og pervasive agent AI ville være en væsentlig drivkraft for industrien. Men hvis Huang har ret, kan det vise sig at være endnu mere en katalysator for vækst - for Nvidia og dets partnere - end nogen ville have forestillet sig for ikke længe siden.

Oplysninger:Nvidia er en rådgivningskunde hos mit firma, Moor Insights &Strategy.